Vitalik: Temor de AGI e ASI, apoia a construção de ferramentas que aumentem a inteligência humana em vez de criar vida superinteligente

Em 22 de dezembro, em resposta aos recentes desenvolvimentos de produtos relacionados à AGI no campo da OpenAI e IA, o fundador do Ethereum, Vitalik Buterin, postou na plataforma X dizendo: "Minha definição de AGI (Inteligência Geral Artificial) é: AGI é uma inteligência artificial suficientemente poderosa que, se um dia todos os humanos desaparecessem repentinamente e essa IA fosse carregada em um corpo robótico, ela seria capaz de continuar a civilização de forma independente.

Obviamente, esta é uma definição muito difícil de medir, mas acho que esta é exatamente a diferença intuitiva central entre 'a IA a que estamos acostumados' e 'AGI' na mente de muitas pessoas. Marca a transição de uma ferramenta que constantemente depende da entrada humana para uma forma de vida autossuficiente. ASI (Inteligência Super Artificial) é completamente outra questão - minha definição é quando os humanos não adicionam mais valor à produtividade no ciclo (assim como nos jogos de xadrez, onde só chegamos a esse ponto na última década.)

Sim, ASI me assusta - até mesmo minha definição de AGI me assusta porque traz riscos óbvios de perda de controle. Apoio focar nosso trabalho na construção de ferramentas de aprimoramento inteligente para humanos em vez de construir formas de vida superinteligentes."

Aviso Legal: o conteúdo deste artigo reflete exclusivamente a opinião do autor e não representa a plataforma. Este artigo não deve servir como referência para a tomada de decisões de investimento.

Talvez você também goste

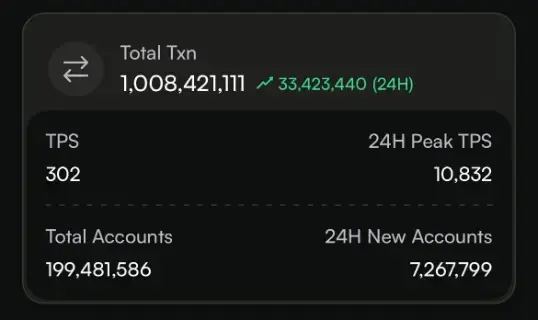

Dados: Volume de Transações do Testnet Monad Excede 1 Bilhão

Lista Lending Adiciona slisBNB e ETH como Ativos Colaterais